Neste artigo, vamos caminhar do zero até a implementação avançada de integrações com a API do ChatGPT. Vou mostrar detalhes desde o cadastro e obtenção da chave, passando pela configuração de requisições e tratamento de erros, até questões de segurança, limitações e vantagens para criação de chatbots com conversas naturais — um campo que não para de evoluir.

Se você já se perguntou o que está por trás dessa “inteligência artificial que conversa sozinha”, ou talvez tenha tido ideias de automatizar a produção de conteúdo como se faz na Automarticles, este guia é para você. Prepare-se para exemplos, opiniões sinceras, algumas digressões e uma pitada do que aprendi nesse caminho cruzando programação e o admirável mundo novo dos robôs falantes.

Por que integrar a API do ChatGPT?

Tudo começa com uma ideia: imagine transformar um FAQ estático em uma experiência interativa, ou substituir aquele suporte repetitivo por um robô solícito e bem-humorado. Ou simplesmente automatizar parte do seu fluxo de produção de conteúdo, como faz a Automarticles pelos seus clientes.

Conversas automatizadas, conteúdo criado do zero, agilidade e escalabilidade.

Mas o fascínio não está apenas na automação. O grande diferencial é como essas ferramentas tornam as interações mais humanizadas. Antes de mergulhar na parte técnica, vale pensar: para quem quero criar? O que espero resolver? Qual o limite dessa automação?

Essas perguntas costumam guiar não apenas pequenas empresas, mas também equipes de tecnologia e freelancers que automatizam jornadas do cliente – e, acredite ou não, o impacto no SEO é enorme, como já discutimos quando falamos sobre como a inteligência artificial está mudando os blogs.

Como funciona a API do ChatGPT, afinal?

A “API do ChatGPT” (ou interface de programação de aplicações do ChatGPT) é basicamente uma ponte. Ela permite o envio de textos para modelos de linguagem avançada, retornando respostas que podem ser integradas a diferentes sistemas, desde assistentes virtuais até geradores automáticos de conteúdo.

Na prática, você envia dados via requisições HTTP, especificando um prompt (pergunta ou comando) e alguns parâmetros. Em troca, recebe uma resposta calculada pelo modelo — normalmente GPT-4 ou versões similares.

É como ter um escritor robótico do outro lado da linha.

Mas, para que isso aconteça, há uma série de passos: registro, geração de chave, configuração e boas práticas de segurança. Não basta apenas saber programar — é fundamental conhecer as engrenagens e as limitações desse serviço. Vamos por partes.

Primeiros passos: cadastro e obtenção da chave de acesso

Para acessar a API, é necessário criar uma conta junto à fornecedora do modelo. Este passo envolve uma validação simples de email e, eventualmente, autenticação em dois fatores para evitar acessos indesejados.

Logo após o login, é possível gerar uma chave de API — guarde bem essa chave! Ela é seu passe de entrada, como já destaca o guia completo de registro e obtenção de chave.

- Acesse o painel do provedor após o login

- Navegue até a área de API Keys

- Clique para gerar uma nova chave

- Copie e armazene a chave em local seguro (preferencialmente em variáveis de ambiente ou serviços protegidos; nunca diretamente no código)

- Restrinja permissões se disponível: alguns sistemas permitem atribuir escopos à sua chave, limitando o acesso a certos recursos

Essas etapas, de tão simples, podem ser negligenciadas. Muita gente manda cópia da chave por mensagem instantânea, coloca em fórum, esquece aberta no GitHub… Erros desse tipo acabam levando a vazamentos. O artigo cita que o ideal é guardar sua chave de API com tanto cuidado quanto uma senha bancária.

Importante também: uma chave é como sua identidade. Se alguém a obtém, pode não só usar seus créditos, como comprometer sua reputação e gerar custos indesejados. Não subestime este passo.

Primeira requisição: configuração do ambiente e envio simples

O próximo passo é configurar o ambiente. Uma das linguagens mais utilizadas para testar a integração é o Python – por sua simplicidade, legibilidade e vasta documentação. Vou seguir com exemplos em Python.

Instalando a biblioteca necessária

- Abra o terminal

- Execute: pip install openai

Pronto. Com isso você poderá usar a biblioteca oficial para comunicação com a API do ChatGPT, referência constante em diversos tutoriais de integração.

Configurando sua primeira requisição

Considere este exemplo básico, usando Python:

import openaiopenai.api_key = 'sua-chave-aqui'response = openai.ChatCompletion.create( model='gpt-4', messages=[ {"role": "user", "content": "Explique como funciona a fotossíntese para uma criança de 5 anos."} ], max_tokens=100)print(response['choices'][0]['message']['content'])Pontos de atenção:

- O parâmetro model define a versão do modelo (gpt-3.5-turbo, gpt-4 etc.)

- O messages é uma lista de “trocas” no chat. Cada item representa quem enviou a mensagem (user ou assistant) e o texto correspondente

- max_tokens limita o tamanho da resposta – sugere-se sempre definir um valor para evitar respostas excessivamente longas

Uma linha pode ser o início de uma inteligência que aprende com você.

Por dentro do retorno da API

O resultado sempre chega como um dicionário estruturado, permitindo refinamento e automação. O campo de maior interesse geralmente está em response['choices'][0]['message']['content'] – é ali que está a resposta elaborada.

Em aplicações reais, você pode incluir várias mensagens (inclusive de “sistema”, para condicionar o tom do assistente), iterar sobre múltiplos resultados e encaminhar as respostas para outros módulos.

Como preparar prompts e criar conversas contextuais?

O segredo das boas interações não está só no código. Grande parte da mágica vem da arte de escrever prompts – textos de comando que guiam o modelo a produzir respostas satisfatórias.

Pergunte melhor. Respostas incríveis surgem.

Veja algumas dicas práticas:

- Seja objetivo ao formular o comando (“Resuma esse artigo em 5 tópicos” é sempre melhor do que “Resuma aí”)

- Teste diferentes níveis de detalhes: às vezes, pedir para explicar para uma criança ou para um especialista pode mudar radicalmente a resposta

- Mantenha histórico do chat (se quiser conversas contínuas), incluindo a sequência de trocas anteriores. O modelo considera o contexto anterior ao formular novas respostas

- Use instruções de sistema no início da sequência para condicionar o estilo do robô (“Você é um professor de biologia simpático”)

Não existe fórmula única, mas vale gastar um tempo testando a abordagem e vendo como pequenos ajustes nos textos dados rendem mudanças interessantes nos resultados.

Trabalhando erros e exceções na integração

Nem tudo funciona sempre de primeira. Logo cedo, desenvolvedores encontram limitações: do uso incorreto da chave de API até estouros de limite de requisições e respostas inesperadas do modelo.

Segundo especialistas reunidos no guia completo sobre tratamento de erros e robustez, os principais problemas e como lidar com eles são esses:

- InvalidRequestError: parâmetros enviados incorretos ou modelo incompatível. Revise os argumentos e a documentação oficial

- AuthenticationError: normalmente chave de API inválida ou expirada. Vale gerar uma nova e atualizar no sistema protegido

- RateLimitError: uso acima do permitido no plano atual. Nesse caso, aplique estratégias de retry automático, backoff exponencial ou limite concorrência

- Timeouts: problemas de rede ou lentidão no modelo. Implemente sempre um timeout mínimo para não deixar seu usuário esperando indefinidamente

- Respostas “em branco” ou “esquecidas”: verifique se o prompt foi enviado corretamente e se os limites de max_tokens e contexto não estouraram

Não ignore mensagens de erro. Elas ensinam mais que mil tutoriais.

Em Python, a estratégia costuma ser envolver toda requisição em um bloco try-except, monitorando erros específicos:

import openaifrom openai.error import InvalidRequestError, AuthenticationError, RateLimitErrortry: # Sua requisição response = openai.ChatCompletion.create(...)except InvalidRequestError as e: print("Parâmetros inválidos:", e)except AuthenticationError as e: print("Erro de autenticação:", e)except RateLimitError as e: print("Muitas requisições. Aguarde e tente novamente:", e)except Exception as e: print("Ocorreu um erro inesperado:", e)Isso deixa o sistema mais estável e amigável para o usuário. Se algo der errado, pelo menos um recado claro será exibido — não só um stacktrace que ninguém entende.

Boas práticas para integração segura e eficiente

É fácil empolgar-se com o potencial da tecnologia e esquecer detalhes que fazem diferença no futuro. Tenho alguns aprendizados que repito sempre que falo de integração robusta com IA:

- Proteja sua chave: nunca faça commit dela no repositório, nem envie sem criptografia

- Regule limites de requisição: defina cotas para evitar custos inesperados e ataques de negação de serviço

- Sanitize dados de entrada e saída: todo texto gerado deve passar por validação, evitando vieses, conteúdos proibidos ou vazamento de informações sensíveis. Isso vai além do compliance: trata-se de construir confiança

- Monitore logs e métricas: coletar estatísticas de uso, analisar exceções e ajustes finos conforme o comportamento dos usuários

- Prefira versões estáveis do modelo: sempre que possível, atualize para releases recomendados pelo provedor

- Leia sobre segurança da chave de API para não ser pego de surpresa

Tecnologia boa é tecnologia confiável.

Esses cuidados valem tanto para startups quanto para freelancers. E sim, para quem está criando blogs do zero, são ainda mais importantes — pois a reputação do seu domínio depende da integridade daquilo que vai ao ar.

Integração avançada: montar chatbots interativos

Agora, o que realmente encanta desenvolvedores é ver um robô respondendo, aprendendo e contextualizando a conversa. Com algumas adaptações, é possível simular múltiplas rodadas de interação, criar diálogos que evoluem e até personalizar a “voz” do assistente.

Exemplo prático: chatbot contextual simples em Python

Veja abaixo uma sequência que mantém o histórico da conversa e envia para a API em todas as rodadas:

import openaiopenai.api_key = 'sua-chave-aqui'histórico = [ {"role": "system", "content": "Você é um consultor financeiro educado e claro."},]while True: prompt = input("Você: ") histórico.append({"role": "user", "content": prompt}) resposta = openai.ChatCompletion.create( model='gpt-4', messages=histórico, max_tokens=120 ) print("Assistente:", resposta['choices'][0]['message']['content']) histórico.append({"role": "assistant", "content": resposta['choices'][0]['message']['content']})Note que a conversa é “alimentada” pelo histórico. Isso significa que o assistente lembra das últimas rodadas da conversa — dentro de um limite chamado context window, normalmente entre 4 a 32 mil tokens, dependendo do modelo.

Em robôs para suporte, FAQ, orientação personalizada e produção de conteúdo automatizado (algo fundamental na Automarticles), essa abordagem cria experiências muito acima dos antigos scripts engessados.

Como personalizar e enriquecer experiências?

- Adapte a “persona” do robô com mensagens de sistema (“Fale como um especialista em marketing digital”)

- Defina limites de resposta para evitar respostas longas, cansativas ou que desviem do tema

- Implemente rotinas de análise de sentimento, verificando se o conteúdo é adequado antes de exibir

- Acople o chatbot a canais reais: WhatsApp, Telegram, webchat — basta transformar prompts e respostas em mensagens para cada ambiente

- Use feedback dos usuários para treinar, aprimorar prompts e ajustar os fluxos automáticos

Esses princípios também são discutidos quando avaliamos como se compara a automação do conteúdo de blogs com inteligência artificial, apontando as vantagens de criar interações realmente personalizadas.

Limitações da API do ChatGPT e alternativas práticas

Por melhor que seja o modelo, ainda há limitações técnicas e éticas no uso comercial dessa tecnologia. Segundo análises sobre o ChatGPT e suas aplicações, algumas barreiras comuns envolvem:

- Alucinações: respostas falsas, incoerentes ou inventadas. O modelo pode criar dados plausíveis, mas sem embasamento — por isso, supervisão humana é mandatória em assuntos sensíveis

- Limite de contexto: chats longos podem perder informações anteriores, pois há um corte no volume de tokens considerados

- Impossibilidade de acesso à internet em tempo real: a maioria dos modelos só trabalha com conhecimento até certo ponto no passado (cutoff date), a menos que acoplados a sistemas externos de busca

- Risco de viés e linguagem inadequada: todo modelo reflete tendências, opiniões e limitações do conteúdo em que foi treinado — por isso, checagem é sempre importante

- Custo variável: uso intenso pode sair caro, pois há cobrança por volume de tokens processados

Nenhum robô substitui o bom senso humano.

Estratégias para mitigar esses desafios:

- Valide todas as respostas sensíveis com regras manuais ou rotinas automatizadas

- Limite o número de rodadas do histórico incluídas no prompt — se precisar de memória longa, armazene resumos e dados essenciais em bancos externos

- Implemente supervisão humana: sempre peça revisão de conteúdo antes de publicação automática em blogs ou canais públicos

- Ajuste prompts para estimular respostas prudentes (“Se não souber, responda: ‘não sei com certeza’”)

Esses pontos, inclusive, já foram destacados quando tratamos sobre ranquear palavras-chave e qualidade do conteúdo para SEO. Não vale apenas gerar volume: é preciso garantir informação útil e verdadeira.

Questões de ética, privacidade e segurança

Criar aplicações automatizadas usando a API do ChatGPT carrega responsabilidades. Não basta colocar um robô a responder perguntas — é necessário refletir sobre segurança de dados, proteção da privacidade e ética de uso.

Entre as recomendações presentes em guias especializados em privacidade e ética:

- Jamais envie informações pessoais sensíveis (CPF, endereços, dados bancários) para a API

- Informe ao usuário quando está interagindo com IA. Crie disclaimers transparentes (“Esta conversa é mediada por inteligência artificial”)

- Implemente logs anônimos, apagando dados pessoais e cumprindo padrões de privacidade como LGPD

- Documente e audite periodicamente o uso para identificar possíveis falhas ou abusos

Confiança é construída com transparência.

Na Automarticles, aliás, sempre reforçamos o compromisso com geração segura, ética e validada de conteúdo. Automatização de blog pode ser uma revolução, mas nunca a qualquer custo. É possível inovar sem ferir princípios — e essa é a base de qualquer boa solução tecnológica.

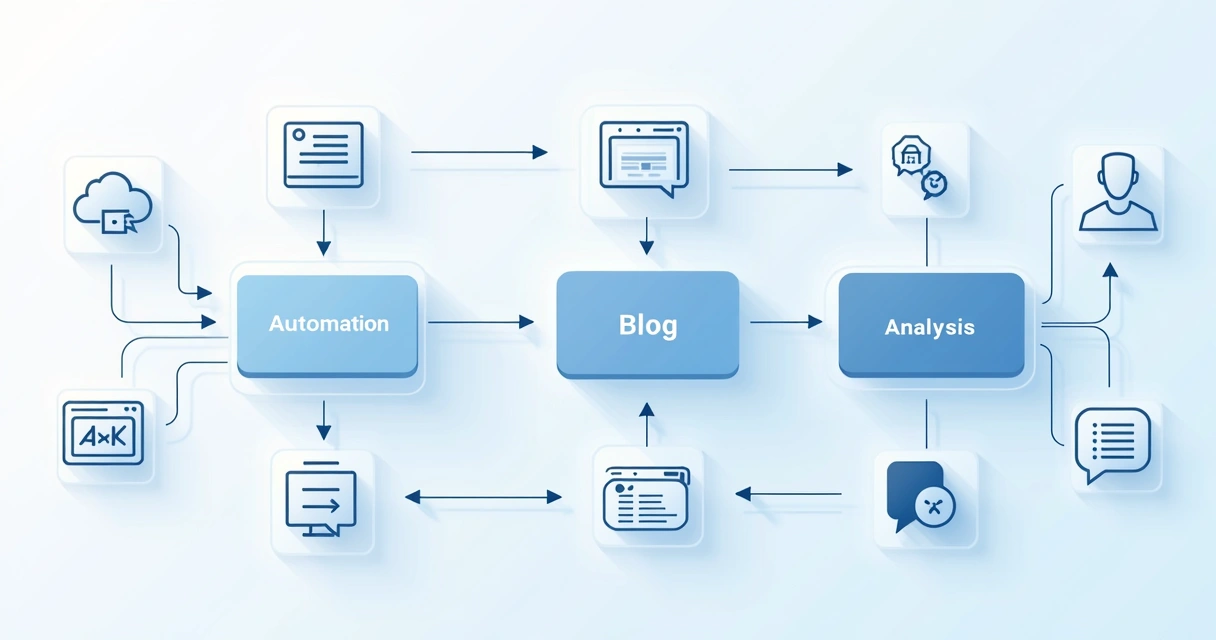

Potencial para produção de conteúdo automatizada

Voltando ao início: por que tanta gente aposta na integração do ChatGPT para automação de conteúdo? Simples. É uma das maneiras mais rápidas de criar diálogos humanos, textos para blogs, FAQ e respostas automatizadas — sem abrir mão do toque personalizado.

A Automarticles, por exemplo, já mostrou como unir geração automatizada de posts com integração direta ao WordPress e outros CMS, acelerando estratégias de SEO sem perder a qualidade do conteúdo. Isso não elimina o papel do humano, mas potencializa resultados.

Uma experiência real: no início, há desconfiança do público sobre textos automáticos. Mas, com refinamento nos prompts, curadoria do conteúdo e explicação de que há auxílio de IA, a taxa de aceitação e engajamento cresce muito. Blogs com robôs são apenas frios quando mal treinados.

Junte a inteligência artificial para criação de conteúdo, automação de imagens para redes sociais, escolha de palavras-chave e integração com ferramentas via webhooks: esse é o futuro do marketing, seja para pequenas empresas ou agências inteiras. E, claro, nunca ignorando limites, regulamentações e o toque humano imprescindível.

Como extrair o máximo e evitar armadilhas?

Se você chegou até aqui, já percebeu que usar a API do ChatGPT abre portas — mas exige responsabilidade, testes, atenção e um filtro crítico para separar o que é automatizável do que merece intervenção manual.

- Teste cada cenário relevante ao seu negócio: FAQ, atendimento, sugestões, análise de sentimentos, produção de campanhas

- Documente seu fluxo, para facilitar manutenção futura e auditoria

- Inclua logs detalhados, mas sempre respeitando privacidade e anonimização de dados

- Repense ideias antigas: se automatizar virou possível, o que você realmente quer automatizar?

- Monitore resultados, faça ajustes contínuos — e nunca caia na armadilha do “deixa rodar e esquece”

A tecnologia serve a você, mas pede atenção constante.

Onde esta tecnologia realmente brilha?

Em resumos automáticos de textos longos, chatbots de vendas, diagnósticos automáticos, assessoria para pequenas empresas, recomendações de conteúdo e até apoio à criatividade. É provável que haja aplicações que ainda nem imaginamos — é esse o lado excitante.

Alguns desenvolvedores contam, por exemplo, sobre como sistemas de IA ajudam a sugerir links internos e estratégias de SEO, levando a resultados práticos como mostramos no artigo sobre como a linkagem interna pode transformar o SEO dos sites. A criatividade, aliada aos recursos certos, pode realmente surpreender.

Se me permite um conselho, não caia na ilusão da automação “mágica”. Invista tempo em entender as respostas, refinar os prompts e construir fluxos claros — aí sim, verá o potencial dessa integração em ação.

O futuro do conteúdo conversacional

Às vezes, paro para pensar: estamos apenas nos primeiros passos do que vai ser possível. Uma API que permite conversar com máquinas — e que aprende — nunca será ferramenta para ser usada sem reflexão. Mas é, de longe, uma das mais interessantes dos últimos anos.

Em tempos onde automação e personalização parecem polos opostos, a integração inteligente da API do ChatGPT mostra que é possível humanizar a escala. Do blog ao chatbot, da pesquisa à jornada do consumidor, o pulo do gato está em combinar criatividade, código limpo e atenção constante às limitações — técnicas e éticas.

Automatizar não é substituir, mas ampliar o que só humanos sabem criar.

Se ficou curioso, recomendo botar em prática tudo o que viu aqui. Teste, ajuste, erre. Acima de tudo, vá além da superfície e repense como você pode usar essa tecnologia a seu favor, seja automatizando tarefas repetitivas, revolucionando o suporte ao cliente ou maravilhando seu público com experiências interativas.

Se precisar de auxílio direto na automatização da criação de conteúdo, integração com WordPress ou dicas de estratégias SEO, conheça mais sobre as soluções da Automarticles. Estamos aqui para ajudar a transformar ideias em resultados — sempre com ética, criatividade e equilíbrio.

FAQ: perguntas frequentes sobre API do ChatGPT

O que é a API do ChatGPT?

A API do ChatGPT é um serviço baseado em nuvem que permite a desenvolvedores integrar o modelo de linguagem GPT em suas próprias aplicações. Ela recebe textos via requisições e devolve respostas automatizadas, sendo usada para criar chatbots, sistemas de suporte, geradores de conteúdo e interfaces conversacionais em diversos contextos.

Como começar a usar a API do ChatGPT?

Para começar, é preciso criar uma conta no provedor oficial do modelo, acessar o painel de desenvolvedores, gerar uma chave de API e instalá-la em seu código ou sistema. Lembre-se de guardar a chave em ambiente protegido. Depois, é só utilizar bibliotecas como a openai para Python, enviando prompts e processando as respostas. Existem guias completos para registro e boas práticas que podem ajudar no passo a passo.

Quanto custa usar a API do ChatGPT?

O custo da API do ChatGPT varia conforme o volume de texto (tokens) enviado e recebido, bem como o modelo escolhido (ex: gpt-3.5 ou gpt-4). Geralmente, há planos com cobrança por uso, possibilitando desde testes gratuitos até pacotes pagos conforme a demanda. É importante acompanhar o seu consumo para ajustar limites e evitar surpresas na fatura.

Quais as melhores práticas com a API?

Algumas boas práticas recomendadas incluem: proteger sua chave de API, validar dados de entrada e saída, monitorar limites de requisições, tratar erros com clareza (como rate limits e autenticação), respeitar questões de privacidade e limitar o histórico enviado para evitar perda de contexto ou custos altos. Sempre monitore logs e revise os resultados manualmente quando necessário.

É seguro integrar a API do ChatGPT?

Sim, desde que você siga práticas seguras: nunca exponha sua chave, evite enviar dados sensíveis, implemente logs anônimos, limite permissões e faça revisões regulares do uso. Utilize sempre conexões seguras (HTTPS) e informe aos usuários quando estiverem conversando com IA. Dessa forma, é possível garantir privacidade, conformidade e confiança na automação.